目录

- 一、ReLU vs LeakyReLU

- 1. ReLU(Rectified Linear Unit)

- 2. LeakyReLU(Leaky Rectified Linear Unit)

- 3. 对比总结

- 4. 代码示例(PyTorch)

- 5. 如何选择?

- 二、Softmax

- 1. Softmax 的定义

- 2. 核心作用

- 3. 特性

- 4. 代码示例(PyTorch)

- 5. 常见问题

- 6. 应用场景

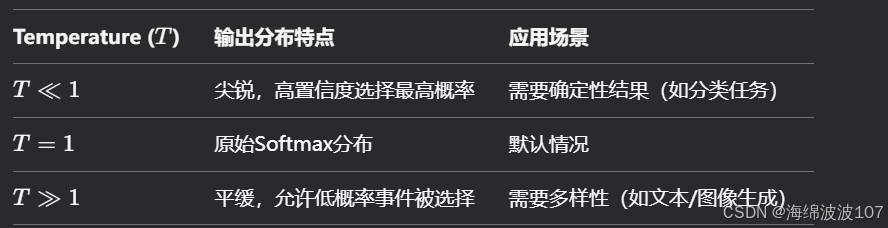

- 三、Temperature

- 1. Temperature 的核心作用

- 2. 数学定义

- 3. 直观理解

- 4. 实际应用示例

- 5. 代码实现(PyTorch)

本文图片出自https://github.com/ImagineAILab/ai-by-hand-excel.git

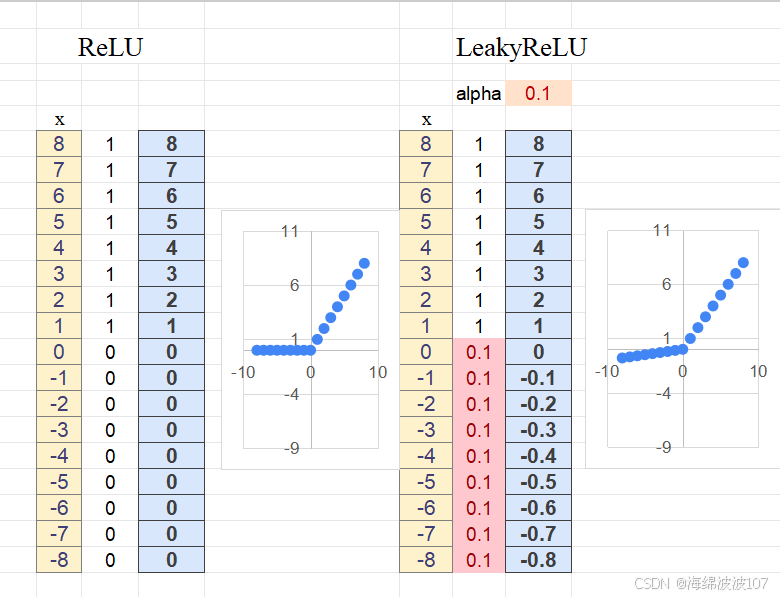

一、ReLU vs LeakyReLU

ReLU(Rectified Linear Unit,修正线性单元)和 LeakyReLU(带泄露的修正线性单元)是深度学习中常用的激活函数,用于引入神经网络的非线性。

1. ReLU(Rectified Linear Unit)

公式:

特点:

-

计算简单:仅需比较和取最大值,计算效率高。

-

稀疏激活:负输入输出为0,可能使部分神经元“死亡”(即永远不被激活)。

-

缓解梯度消失:正区间的梯度恒为1,避免了梯度消失问题(相较于Sigmoid/Tanh)。

缺点:

- Dead ReLU问题:如果输入始终为负(如权重初始化不当或学习率过高),梯度为0,神经元无法更新。

使用场景:

- 大多数前馈神经网络的隐藏层(CNN、MLP等)。

2. LeakyReLU(Leaky Rectified Linear Unit)

特点:

-

解决Dead ReLU问题:负区间引入微小梯度(α),避免神经元完全失效。

-

保留ReLU的优点:正区间仍保持线性且梯度为1。

变体:

-

Parametric ReLU (PReLU):将 α 作为可学习参数,由模型自动调整。

-

Randomized LeakyReLU (RReLU):在训练时随机采样 α,增强正则化效果。

缺点:

- 需要手动设置或学习 α(但通常固定为0.01即可)。

使用场景:

- 当担心ReLU导致神经元死亡时(如训练不稳定或稀疏性过强)。

3. 对比总结

4. 代码示例(PyTorch)

import torch

import torch.nn as nn# 定义ReLU和LeakyReLU

relu = nn.ReLU() # 默认参数

leaky_relu = nn.LeakyReLU(0.01) # alpha=0.01x = torch.tensor([-1.0, 0.0, 2.0])

print(relu(x)) # 输出: tensor([0., 0., 2.])

print(leaky_relu(x))# 输出: tensor([-0.0100, 0.0000, 2.0000])

5. 如何选择?

优先尝试ReLU:因其简单高效,适合大多数情况。

不稳定时换LeakyReLU:若模型出现大量死亡神经元(如某些层输出全0),可改用LeakyReLU或PReLU。

特殊场景:GANs或生成模型中,LeakyReLU可能表现更好(因需平衡生成器和判别器)。

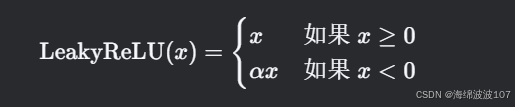

二、Softmax

Softmax 是深度学习和机器学习中常用的 归一化函数,主要用于 多分类问题 的输出层,将原始分数(logits)转换为概率分布。

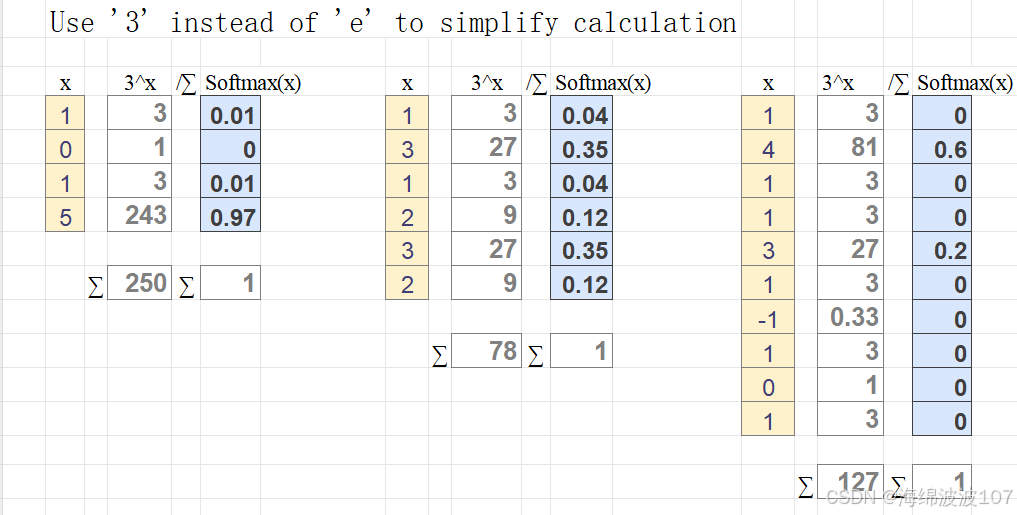

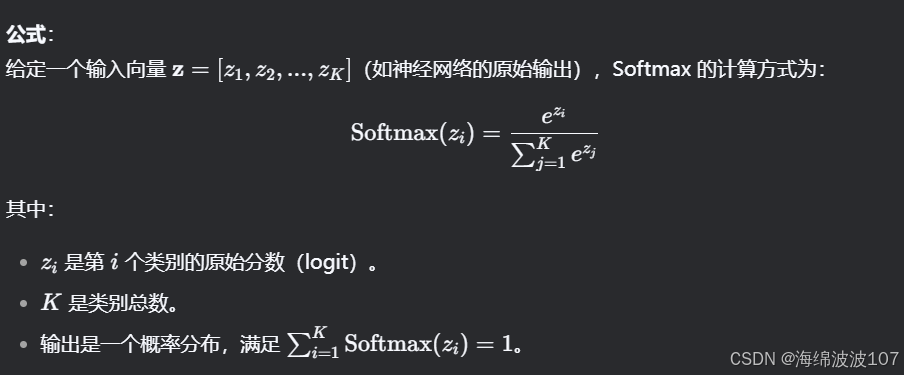

1. Softmax 的定义

2. 核心作用

概率化输出:

将神经网络的原始输出(可能为任意实数)转换为 0 到 1 之间的概率值,且所有类别的概率之和为 1。

例如:三分类的输出 [3.0, 1.0, 0.2] 经过 Softmax 后变为 [0.84, 0.11, 0.05]。

突出最大值:

通过指数运算放大高分值的比重,使得最大值的概率更显著(但对极端值敏感,需注意数值稳定性)。

与交叉熵损失配合:

在多分类任务中,Softmax 常与 交叉熵损失(Cross-Entropy Loss) 结合使用,优化模型参数。

3. 特性

单调性:输入 z i越大,输出概率越高。

平移不变性:对输入向量 z 整体加减常数,Softmax 结果不变(因指数运算抵消偏移)。

数值稳定性:实际实现时,通常会减去最大值,防止指数爆炸。

4. 代码示例(PyTorch)

import torch

import torch.nn as nn# 定义Softmax

softmax = nn.Softmax(dim=1) # dim=1表示对每行的所有列计算# 原始输出(假设3个样本,每个样本3个类别)

logits = torch.tensor([[3.0, 1.0, 0.2], [1.0, 2.0, 3.0]])# 计算概率分布

probabilities = softmax(logits)

print(probabilities)

5. 常见问题

Q1: Softmax 和 Sigmoid 的区别?

Softmax:用于多分类,所有类别概率和为 1。

Sigmoid:用于二分类或独立多标签分类(每个类别独立判断,概率不要求和为 1)。

Q2: 为什么用指数而不是直接归一化?

指数函数能更好放大差异,使模型更自信地选择高分数类别。但这也可能导致过拟合,可通过标签平滑(Label Smoothing)缓解。

Q3: 如何解决数值溢出?

实际实现时会对输入做平移(减去最大值):

def stable_softmax(z):z = z - torch.max(z, dim=1, keepdim=True)[0]return torch.exp(z) / torch.sum(torch.exp(z), dim=1, keepdim=True)

6. 应用场景

多分类神经网络(如图像分类、文本分类)。

注意力机制(如 Transformer 中的注意力权重计算)。

生成模型(如输出概率分布时)。

三、Temperature

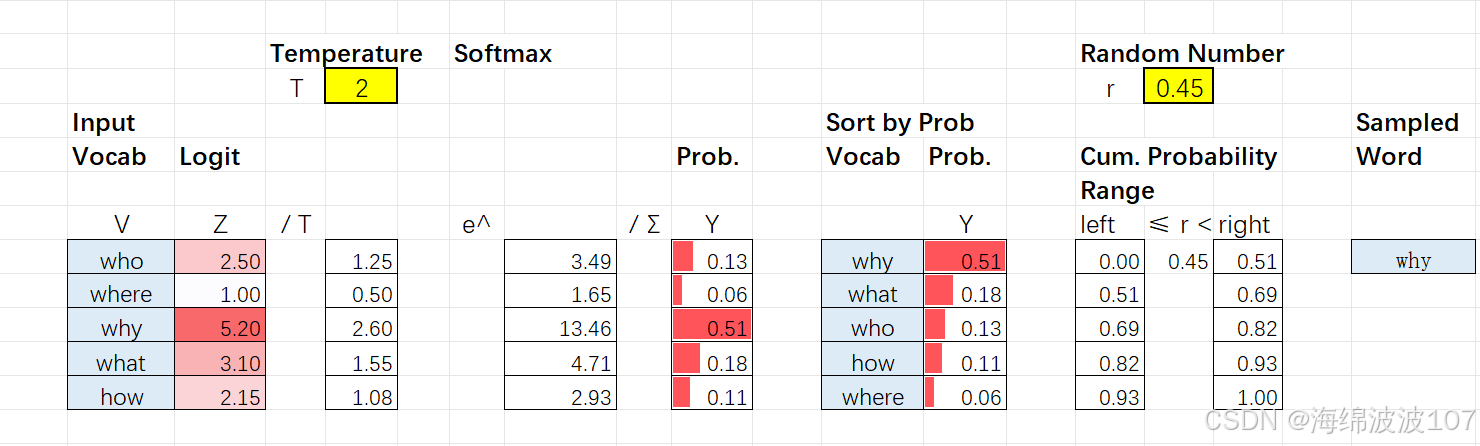

在AI算法中,Temperature(温度)是一个超参数,主要用于调整概率分布的形状,控制模型的确定性或随机性。它常见于生成模型(如LLM)、强化学习和贝叶斯方法中,尤其在Softmax函数中使用时效果显著。

1. Temperature 的核心作用

Temperature(通常记作 T)通过缩放原始分数(logits)来改变输出概率的分布特性:

T→0(低温):

模型输出更尖锐(确定性强),概率集中到最高分的类别(接近one-hot分布)。

例如:生成文本时更保守,选择最可能的词,但可能缺乏多样性。

T=1:

标准Softmax,不改变原始分布。

T→∞(高温):

模型输出更平滑(随机性强),概率趋于均匀分布,生成结果更多样化(但可能不连贯)。

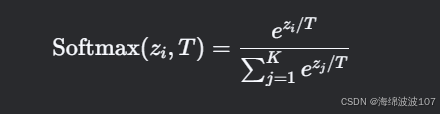

2. 数学定义

在Softmax中引入Temperature的公式:

3. 直观理解

4. 实际应用示例

案例1:文本生成(LLM)

低 T(如0.5):

生成更保守、可预测的文本(例如:“The cat sat on the mat.”)。

高 T(如1.5):

生成更创意、多样化的文本(例如:“The feline perched atop the woven rug, purring softly.”)。

案例2:强化学习(策略探索)

高 T 鼓励智能体探索更多动作,低 T 则倾向于利用已知最优动作。

5. 代码实现(PyTorch)

import torch

import torch.nn.functional as Flogits = torch.tensor([3.0, 1.0, 0.2]) # 原始分数def softmax_with_temperature(logits, T=1.0):return F.softmax(logits / T, dim=-1)# 不同Temperature的效果

print("T=0.5:", softmax_with_temperature(logits, T=0.5)) # 输出更尖锐

print("T=1.0:", softmax_with_temperature(logits, T=1.0)) # 标准Softmax

print("T=2.0:", softmax_with_temperature(logits, T=2.0)) # 输出更平滑